Dans un processus de mesure réel, en raison de l'influence de facteurs aléatoires, il existe toujours une dispersion des lectures aléatoires d'un ou de différents instruments ou une dispersion des valeurs mesurées aléatoires obtenues à la suite de la mise en œuvre d'une ou plusieurs techniques de mesure. (MI) de la même quantité mesurée. Le but de toute mesure est de trouver véritable signification grandeur mesurée – une valeur qui correspond à la définition de la grandeur mesurée (valeur vraie). À partir de la définition formulée, il doit être clair dans quelles conditions une grandeur prend une valeur constante unique qui correspond à l'objectif de la mesure.

Il faut admettre que la valeur mesurée (ou lecture de l'instrument) est toujours la réalisation d'une variable aléatoire à un moment précis , qui n'est lié qu'à sa vraie valeur dépendance probabiliste, et ça axiome. C'est pourquoi plusieurs mesures peuvent être considérées comme une série de mesures uniques sur un certain intervalle de temps, dans chacun desquels est enregistrée une lecture d'instrument (ou une valeur mesurée d'une grandeur lors de la mise en œuvre de la technique de mesure).

Lors de la construction d’une théorie de la mesure, deux choses doivent être prises en compte les propriétés générales toutes les mesures :

1) incertitude sur la valeur vraie de la grandeur mesurée (valeur vraie) ;

2) incertitude de l'espérance mathématique des valeurs mesurées (valeur attendue).

Sur la base de ces deux propriétés des mesures, la base métrologie mets deux postulat:

1) la vraie valeur de la grandeur mesurée existe, elle est constante (au moment de la mesure) et ne peut être déterminée ;

2) l'espérance mathématique des valeurs mesurées aléatoires d'une grandeur existe, elle est constante et ne peut être déterminée .

De ces postulats il résulte que le caractère aléatoire de la valeur mesurée d'une grandeur donne lieu à incertitudeécarts de toute valeur moyenne mesurée d'une grandeur, à la fois par rapport à sa véritable signification, et de espérance mathématique valeurs mesurées.

Ils soulignent également deux axiomes métrologie:

Sans un instrument de mesure qui stocke une unité de quantité, la mesure est impossible ;

Sans information a priori (sur l'objet, les normes, les moyens et conditions de mesure), les mesures sont impossibles.

En conséquence de ces postulats, deux affirmations peuvent être distinguées :

conséquence n°1– « il existe une vraie valeur de l'écart de la valeur mesurée d'une grandeur par rapport à sa vraie valeur (la vraie valeur de la correction) et elle ne peut pas être déterminée » ;

conséquence n°2– « transférer une unité de quantité à un instrument de mesure sans erreur est impossible. »

Dans les documents de métrologie internationale, le mot « vrai" est parfois omis et simplement le terme " valeur de la quantité» . On pense que les concepts valeur vraie de la grandeur mesurée" Et " grandeur mesurée" équivalent.

Dans la monographie de Rabinovich S.G. les postulats de métrologie suivants sont proposés : « il existe une valeur vraie de la grandeur mesurée (1), elle est unique (2), est une constante (3) et ne peut être déterminée (4) ».

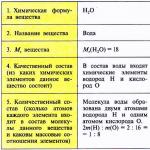

Mesures de grandeurs physiques

L'homme, en tant que partie intégrante de la nature, connaît le monde physique qui l'entoure principalement en mesurant des quantités. Théorie de la connaissance - épistémologie fait référence à la philosophie, qui considère les catégories de qualité et de quantité, qui sont utilisées ci-dessus dans la définition du concept « ordre de grandeur».

Des informations initiales fiables obtenues en mesurant des quantités, des paramètres et des indicateurs constituent la base de toute forme de gestion, d'analyse, de prévision, de planification, de contrôle et de régulation. Il est également important dans l'étude des ressources naturelles, dans le contrôle de leur utilisation rationnelle, dans la protection de l'environnement et dans la garantie de la sécurité environnementale.

Les mesures jouent un rôle énorme dans la société moderne ; dans les pays développés, jusqu'à 10 % du travail social y est consacré.

En mesurant appelé " processus d'obtention expérimentale d'une ou plusieurs valeurs d'une grandeur qui peut être raisonnablement attribuée à la grandeur mesurée". Ici le mot " un» doit être considéré comme une exception lorsque les informations d'erreur sont généralement connues (par défaut) et ne sont pas indiquées dans le résultat de la mesure uniquement par souci de simplicité. Sinon, une seule valeur mesurée spécifiée serait considérée comme vraie.

La mesure est également appelée un ensemble d'opérations effectuées pour déterminer la valeur quantitative d'une quantité. Cette définition est formulée dans la loi fédérale. Malheureusement, cela laisse une liberté dans l’interprétation de l’expression « valeur quantitative d'une quantité» et n'exclut pas la présentation d'une seule valeur mesurée d'une grandeur.

Auparavant, la mesure était appelée le processus de comparaison d'une quantité avec sa valeur prise comme unité. Cette définition, à notre avis, reflète adéquatement l’essence du processus de mesure. « La mesure est la clarification de la valeur de la grandeur mesurée » est également noté dans certaines sources.

Il existe une définition plus générale du concept " la mesure» – obtenir sur l'axe numérique un reflet abstrait de la propriété réelle d'un objet de mesure dans les conditions de réalité physique dans lesquelles il se trouve. Cette réflexion abstraite est un nombre (abstraction mathématique).

La mesure implique une description de la grandeur conformément à l'utilisation prévue du résultat de mesure, une technique de mesure et un instrument de mesure fonctionnant conformément à la procédure de mesure réglementée, ainsi que la prise en compte des conditions de mesure.

La mesure est basée sur n'importe quel phénomènes du monde matériel appelé principe de mesure. Par exemple, l'utilisation de l'attraction gravitationnelle lors de la mesure de la masse d'objets, de substances et de matériaux par pesée.

Pour mettre en œuvre le principe de mesure, il est utilisé méthode de mesure – une technique ou un ensemble de techniques permettant de comparer une quantité mesurée avec son unité ou de la relier à une échelle. Il existe des méthodes d'évaluation directe et des méthodes de comparaison. Les méthodes de comparaison, à leur tour, sont divisées en méthode différentielle (zéro), méthode de substitution et méthode de coïncidence.

Grandeur mesurée (paramètre mesuré) – grandeur à mesurer. Il s'agit d'un paramètre (ou fonctionnalité de paramètres) du modèle d'un objet mesuré, exprimé en unités de grandeur ou en unités relatives indiquant les conditions de mesure et accepté par le sujet comme étant mesuré par définition. Par exemple, la longueur d'une tige d'acier est la distance la plus courte entre ses surfaces d'extrémité planes parallèles à une température de (20 ± 1) o C.

Objet de mesure – un objet matériel caractérisé par une ou plusieurs quantités mesurables.

Ainsi, il faut bien distinguer les notions « ordre de grandeur" Et " grandeur mesurée», dont le sens et la définition diffèrent considérablement. Concept ordre de grandeur appartient à la catégorie philosophique " général» et est formulé pour un ensemble d’objets, comme pour toute mesure de quantité en général. Concept grandeur mesurée appartient à la catégorie " privé" et est formulé par rapport au modèle sélectionné d'un objet spécifique ou d'un ensemble d'objets similaires pour des conditions de mesure fixes.

Compte tenu de l'imperfection des étalons, des instruments de mesure fonctionnels et du processus de mesure dans son ensemble, l'expression de la valeur réelle de la quantité mesurée Dans l'està un moment donné peut théoriquement être représenté par une équation :

Où En échange– Lecture SI (valeur mesurée d’une grandeur) ;

source θ– la valeur réelle de la correction de la lecture de l'instrument dans les conditions de mesure de fonctionnement (soit avec un signe « + », soit avec un signe « - »).

Comme la vraie valeur d’une grandeur n’est jamais connue, la vraie valeur de la correction ne peut être déterminée (voir corollaire n°2 ci-dessus). Cela signifie l'expression :

(2)

(2)

ne peut avoir une valeur pratique qu'avec une modélisation mathématique du processus de mesure, lorsque la valeur réelle d'une quantité peut être spécifiée avec une erreur déterminée uniquement par les capacités (capacité en bits) de la technologie informatique. La vraie valeur de la correction ne peut pas être qualifiée d'« erreur de signe opposé », car elle ne peut jamais et jamais être utilisée pour décrire le processus de mesure.

Il est souvent nécessaire de rapprocher le plus possible la valeur mesurée d'une quantité de sa valeur réelle. Pour ce faire, les relevés du dispositif stockant l'unité sont ajustés en introduisant des corrections additives déterminées dans les conditions suivantes :

1) normale– de préciser l'unité de quantité préalablement transférée à l'appareil à l'aide d'un étalon ;

2) ouvriers– prendre en compte les changements dans les lectures des instruments par rapport aux lectures du même SI dans des conditions normales.

Premier type d'amendement (θn) aux lectures du SI stockant l'unité, est évalué lors de son étalonnage sous des conditions normales comme la différence entre la valeur de référence ( En fr) et indication (valeur mesurée Tel que modifié) Par

formule:

(3)

(3)

Si, lors de la mesure d'une valeur constante reproduite par un étalon, une dispersion des lectures est observée, alors une dispersion des corrections est observée et la valeur de correction moyenne doit être calculée.

Deuxième type de correction θ р aux lectures du SI stockant l'unité est évaluée lors de son étalonnage comme la différence entre la valeur ( Tel que modifié), mesuré en conditions normales, et la valeur ( En mesure.r), mesuré en les conditions de travail,

selon la formule :

(4)

(4)

S'il existe également une dispersion dans les lectures SI, la correction est calculée sur la base des valeurs moyennes dans des conditions normales et de fonctionnement.

Pour obtenir la valeur mesurée finale d'une grandeur, la correction du premier type et toutes les corrections obtenues du deuxième type doivent être ajoutées aux lectures SI avec leurs signes.

Un certain temps est consacré aux mesures, pendant lequel la valeur mesurée elle-même et l'instrument de mesure peuvent changer. Pendant ce temps, de nombreuses lectures aléatoires sont enregistrées et la valeur moyenne est prise comme valeur mesurée.

On peut justifier par une valeur réelle est mesurée, et la valeur mesurée est attribuée à un paramètre du modèle objet. Tout d'abord, une valeur est sélectionnée pour décrire la propriété de l'objet et une unité standard pour cette valeur. Ensuite, la définition du paramètre mesuré du modèle de cet objet est formulée et une méthode de mesure de ce paramètre est construite à partir d'une lecture unique ou de la moyenne de plusieurs lectures de l'instrument de mesure.

L'étalon de l'unité de grandeur n'est pas directement impliqué dans le processus de mesure. On pense que le SI utilisé dans le processus de mesure stocke déjà une unité de quantité précédemment transmise par l'étalon..

Actuellement, sur la base de la théorie des probabilités et des statistiques mathématiques, deux approches se forment pour la construction d'une théorie générale des mesures (pour la description mathématique du processus de mesure réel) :

1) basé sur concept d'incertitude;

2) basé sur notion d'erreur.

Notion d'incertitude

Puisque la vraie valeur est toujours inconnue, alors autour de la valeur mesurée aléatoire de la quantité la plage de valeurs vraies possibles est prédite, chacune pouvant raisonnablement être attribuée à la valeur mesurée avec des probabilités différentes. En pratique, une seule valeur mesurée (par exemple moyenne) est généralement indiquée, mais avec elle

fournir des indicateurs qui reflètent le degré d'incertitude de l'écart possible de cette valeur mesurée par rapport à la valeur vraie inconnue

quantités.

Le concept d'incertitude de mesure est basé sur les idées qui sous-tendent la norme d'État de l'URSS GOST 8.207-73, qui est toujours en vigueur aujourd'hui. Il est construit sur une séquence logique : « incertitude des mesures(en tant que propriété générale) - indicateurs d'incertitude - évaluation de ces indicateurs».

L'incertitude des mesures est due à deux raisons principales :

1) l'impossibilité de compter un nombre infini de lectures (nombre limité de valeurs mesurées) ;

2) une connaissance limitée de tous les effets systématiques du processus de mesure réel qui influencent la valeur mesurée d'une grandeur, y compris une connaissance limitée de l'unité standard de grandeur et des conditions de mesure.

Après avoir introduit tous les amendements connus il reste une incertitude sur l'écart de l'estimation la plus probable de la valeur mesurée par rapport à sa valeur vraie, exprimée par l'indicateur total.

Selon la définition ISO " l'incertitude de mesure est un paramètre associé à un résultat de mesure qui caractérise la dispersion des valeurs d'une grandeur qui pourrait raisonnablement être attribuée à la grandeur mesurée" (1995).

Tel que défini par la norme ISO 2008, " l'incertitude de mesure est non négatif paramètre caractérisant la dispersion des valeurs de grandeur attribuées à la grandeur mesurée en fonction des informations de mesure» .

De ces définitions, il résulte que le nombre paramètre reflète la dispersion des valeurs des quantités. Cette multitude de significations éparses ne peut s'exprimer espacé sur la droite numérique . En pratique, cet intervalle a toujours été appelé erreur.

Cependant, l'ISO propose que l'incertitude de mesure soit caractérisée par les trois indicateurs suivants avec le mot « incertitude» :

1) norme incertitude, exprimé en écart type (SD);

2) norme totale incertitude b;

3) étendu incertitude– le produit de l'incertitude type totale et du facteur de couverture, qui dépend de la probabilité.

Ces indicateurs d'incertitude peuvent être évalués par des méthodes statistiques (méthode A) et probabilistes (méthode B).

Dans la notion d'incertitude, évaluer le résultat des mesures prises séparé de la comparaison valeur mesurée avec une autre valeur connue, telle qu'une valeur de référence. On estime que toutes les corrections possibles ont été évaluées et introduites avant la présentation du résultat de la mesure, et que leurs indicateurs d'incertitude ont également été raisonnablement évalués.

Dans les pays étrangers, pour présenter les résultats des mesures, on utilise principalement les trois indicateurs indiqués avec le mot « incertitude », et le mot « erreur» n’est presque jamais utilisé.

Les inconvénients du concept d'incertitude incluent la contradiction dans les indicateurs sélectionnés, dans lesquels le mot « incertitude", ce qui signifie quelque chose en principe indéfinissable ( incompressible), mais il est néanmoins proposé de le définir.

Notion d'erreur

La notion d'erreur constitue la base des documents réglementaires russes et repose sur le concept « erreur de mesure", qui depuis 2015 est défini comme " différence entre la valeur mesurée et la valeur de référence". Auparavant, dans GOST 16273-70, il était défini comme différence entre la valeur mesurée d'une grandeur et la valeur réelle d'une grandeur, et dans RMG 29-99 comme écart du résultat de la mesure par rapport à la valeur vraie (réelle) de la grandeur. Il est clair que le mot « valeur de référence" est devenu un substitut à la phrase mal choisie " vraie (réelle) valeur" La notion d’erreur repose sur la séquence logique : « erreur - caractéristique de l'erreur - modèle d'erreur - estimation de l'erreur».

L'erreur est considérée comme connue si, par exemple, la valeur de référence connue lors de l'étalonnage du SI est prise comme valeur de référence. Si la vraie valeur est prise comme valeur de référence, alors l'erreur est considérée comme inconnue (indéterminable).

Ce concept tente d'utiliser un terme " erreur» combiner deux processus incompatibles lorsqu'une valeur mesurée aléatoire attribué à inconnu valeur mesurée et lorsque la même valeur mesurée aléatoire par rapport avec un autre célèbre la valeur de la quantité. Ambiguïté du terme " erreur", qui dans différentes situations peut correspondre à la fois à une valeur connue (définissable) et inconnue (indéfinissable), conduit à chaque fois à la nécessité clarifier le sens ce concept dans chaque situation spécifique. La contradiction subsistant dans la définition du terme de base ne contribue en aucun cas à une compréhension claire de l'essence du processus de mesure.

Évidemment, pour décrire et présenter le résultat de la mesure, le terme « erreur de mesure"avec la définition proposée ne peut être utilisé ni dans le cas où l'erreur est inconnue, ni dans le cas où elle est déjà connue, puisqu'une correction peut toujours être introduite. Par conséquent, pour représenter le résultat de la mesure, un nouveau terme était nécessaire - " caractéristique d'erreur de mesure“, c’est-à-dire une caractéristique de quelque chose qui est fondamentalement indéfinissable et ne peut être qu’estimée. Par exemple, une telle caractéristique est souvent utilisée » limites de confiance – un intervalle dans lequel l’erreur de mesure se situe avec une probabilité donnée", ce qui est proche du concept " incertitude élargie» dans la notion d’incertitude.

Puisque les deux concepts scientifiques considérés reflètent les deux phénomènes - dispersion des lectures et différence inconnue entre la valeur mesurée et la valeur réelle d'une quantité, puis les termes correspondants « erreur aléatoire" Et " erreur systématique», qui sont toujours présents dans les mesures, il convient de donner un sens aux indicateurs probabilistes d'incertitude de mesure.

Notez également que le résultat des mesures est un intervalle, l'erreur est le même intervalle (ceci est indiqué par le symbole « ± "), toute correction avec son erreur est aussi un intervalle.

Le premier axiome de la métrologie Sans information a priori, la mesure est IMPOSSIBLE Ø L'énoncé de la tâche de mesure doit contenir : 1. 2. Ø Que mesurer ? Avec quelle erreur (incertitude) ? « Que mesurer ? " contient une information a priori : Ø Ø Ø dimension de la grandeur mesurée, plage de la taille de la grandeur mesurée (de Q 1 à Q 2) " Avec quelle erreur (incertitude) ? » contient des informations a priori : Ø plage d'erreur (incertitude) du résultat de mesure de la grandeur mesurée (de Q 3 à Q 4) 2

Le premier axiome de la métrologie Sans information a priori, la mesure est IMPOSSIBLE Ø L'énoncé de la tâche de mesure doit contenir : 1. 2. Ø Que mesurer ? Avec quelle erreur (incertitude) ? « Que mesurer ? " contient une information a priori : Ø Ø Ø dimension de la grandeur mesurée, plage de la taille de la grandeur mesurée (de Q 1 à Q 2) " Avec quelle erreur (incertitude) ? » contient des informations a priori : Ø plage d'erreur (incertitude) du résultat de mesure de la grandeur mesurée (de Q 3 à Q 4) 2

Premier axiome de métrologie Modèle d'information a priori Modèle d'information a posteriori p(Q) Q 1 Q 2 Q Q 3 Q 4 Q L'entropie est utilisée comme mesure de l'incertitude : Quantité d'information (selon Shannon) 3

Premier axiome de métrologie Modèle d'information a priori Modèle d'information a posteriori p(Q) Q 1 Q 2 Q Q 3 Q 4 Q L'entropie est utilisée comme mesure de l'incertitude : Quantité d'information (selon Shannon) 3

Premier axiome de métrologie Ø Le premier axiome de métrologie fait référence à la situation avant la mesure. Ø Si nous ne savons pas ce que nous allons mesurer, si nous n’avons pas d’informations qualitatives et quantitatives, alors nous ne saurons rien. Ø Si tout est connu sur une grandeur (en particulier ses informations quantitatives), alors la mesure n'est pas nécessaire. Ø La mesure est provoquée par un manque d'informations a priori sur les caractéristiques quantitatives d'une certaine quantité et vise à la réduire. Ø La mesure est la clarification de la valeur de la quantité mesurée 4

Premier axiome de métrologie Ø Le premier axiome de métrologie fait référence à la situation avant la mesure. Ø Si nous ne savons pas ce que nous allons mesurer, si nous n’avons pas d’informations qualitatives et quantitatives, alors nous ne saurons rien. Ø Si tout est connu sur une grandeur (en particulier ses informations quantitatives), alors la mesure n'est pas nécessaire. Ø La mesure est provoquée par un manque d'informations a priori sur les caractéristiques quantitatives d'une certaine quantité et vise à la réduire. Ø La mesure est la clarification de la valeur de la quantité mesurée 4

Expérience de mesures antérieures Ø Si lors de mesures similaires réalisées antérieurement Ø Ø par le même expérimentateur dans les mêmes conditions et avec le même instrument de mesure, l'incertitude du résultat de la mesure et le fait qu'il ne dépend pas de la valeur de la grandeur mesurée ont été établis, alors avec un degré de confiance suffisant, nous pouvons supposer que l'incertitude des résultats de mesure nouvellement obtenus restera la même si la qualification Ø Ø Ø de l'expérimentateur, les conditions de mesure, l'état de fonctionnement de l'instrument de mesure ne changent pas. 6

Expérience de mesures antérieures Ø Si lors de mesures similaires réalisées antérieurement Ø Ø par le même expérimentateur dans les mêmes conditions et avec le même instrument de mesure, l'incertitude du résultat de la mesure et le fait qu'il ne dépend pas de la valeur de la grandeur mesurée ont été établis, alors avec un degré de confiance suffisant, nous pouvons supposer que l'incertitude des résultats de mesure nouvellement obtenus restera la même si la qualification Ø Ø Ø de l'expérimentateur, les conditions de mesure, l'état de fonctionnement de l'instrument de mesure ne changent pas. 6

Conditions de mesure Ø Les conditions de mesure normales sont des conditions de mesure caractérisées par un ensemble de valeurs ou de plages de valeurs de grandeurs d'influence, dans lesquelles la modification du résultat de mesure est négligée en raison de sa petitesse. Ø Remarque Ø Les conditions normales de mesure sont établies dans les documents réglementaires pour les instruments de mesure d'un type spécifique ou en fonction de leur vérification (étalonnage). dix

Conditions de mesure Ø Les conditions de mesure normales sont des conditions de mesure caractérisées par un ensemble de valeurs ou de plages de valeurs de grandeurs d'influence, dans lesquelles la modification du résultat de mesure est négligée en raison de sa petitesse. Ø Remarque Ø Les conditions normales de mesure sont établies dans les documents réglementaires pour les instruments de mesure d'un type spécifique ou en fonction de leur vérification (étalonnage). dix

Conditions de mesure Ø Valeur normale de la grandeur d'influence – la valeur de la grandeur d'influence définie comme nominale. Ø Ø Ø Remarque Lors de la mesure de plusieurs grandeurs, la valeur de température normale est de 20 °C, et dans les autres cas, la température normale est de 23 °C. La plage normale de valeurs d'une grandeur d'influence est la plage de valeurs d'une grandeur d'influence dans laquelle la modification du résultat de mesure sous son influence peut être négligée conformément aux normes de précision établies. Ø Ø Exemple La plage normale des valeurs de température lors du contrôle des éléments normaux de classe de précision 0,005 dans un thermostat ne doit pas changer de plus de ± 0,05 °C par rapport à la température réglée de 20 °C, c'est-à-dire être comprise entre 19,95 et 20 , 05°C. onze

Conditions de mesure Ø Valeur normale de la grandeur d'influence – la valeur de la grandeur d'influence définie comme nominale. Ø Ø Ø Remarque Lors de la mesure de plusieurs grandeurs, la valeur de température normale est de 20 °C, et dans les autres cas, la température normale est de 23 °C. La plage normale de valeurs d'une grandeur d'influence est la plage de valeurs d'une grandeur d'influence dans laquelle la modification du résultat de mesure sous son influence peut être négligée conformément aux normes de précision établies. Ø Ø Exemple La plage normale des valeurs de température lors du contrôle des éléments normaux de classe de précision 0,005 dans un thermostat ne doit pas changer de plus de ± 0,05 °C par rapport à la température réglée de 20 °C, c'est-à-dire être comprise entre 19,95 et 20 , 05°C. onze

Conditions de mesure Ø Ø Plage de travail des valeurs de la grandeur d'influence – plage de valeurs de la grandeur d'influence, dans laquelle l'erreur supplémentaire ou la modification des lectures de l'instrument de mesure est normalisée. Les conditions de mesure de fonctionnement sont des conditions de mesure dans lesquelles les valeurs des grandeurs d'influence se trouvent dans les zones de travail. Ø Exemples Ø 1. Pour un condensateur de mesure, l'erreur supplémentaire est normalisée pour l'écart de la température ambiante par rapport à la normale. Ø 2. Pour un ampèremètre, le changement des lectures provoqué par un écart de la fréquence du courant alternatif par rapport à 50 Hz est normalisé (50 Hz dans ce cas est pris comme valeur de fréquence normale). 12

Conditions de mesure Ø Ø Plage de travail des valeurs de la grandeur d'influence – plage de valeurs de la grandeur d'influence, dans laquelle l'erreur supplémentaire ou la modification des lectures de l'instrument de mesure est normalisée. Les conditions de mesure de fonctionnement sont des conditions de mesure dans lesquelles les valeurs des grandeurs d'influence se trouvent dans les zones de travail. Ø Exemples Ø 1. Pour un condensateur de mesure, l'erreur supplémentaire est normalisée pour l'écart de la température ambiante par rapport à la normale. Ø 2. Pour un ampèremètre, le changement des lectures provoqué par un écart de la fréquence du courant alternatif par rapport à 50 Hz est normalisé (50 Hz dans ce cas est pris comme valeur de fréquence normale). 12

Deuxième axiome de la métrologie « Il est impossible de mesurer une grandeur autrement qu'en acceptant comme connue une autre grandeur de même nature et en indiquant le rapport dans lequel elle se trouve avec elle » (L. Euler) « Tout se connaît par comparaison » (Sagesse populaire) La mesure est une comparaison des tailles par une personne expérimentée. Le deuxième axiome concerne la procédure de mesure et dit que comparer les tailles expérimentalement est le seul moyen d'obtenir des informations de mesure. Dans le même temps, il n'est pas précisé comment les tailles sont comparées, avec quels appareils, appareils ou sans eux. 13

Deuxième axiome de la métrologie « Il est impossible de mesurer une grandeur autrement qu'en acceptant comme connue une autre grandeur de même nature et en indiquant le rapport dans lequel elle se trouve avec elle » (L. Euler) « Tout se connaît par comparaison » (Sagesse populaire) La mesure est une comparaison des tailles par une personne expérimentée. Le deuxième axiome concerne la procédure de mesure et dit que comparer les tailles expérimentalement est le seul moyen d'obtenir des informations de mesure. Dans le même temps, il n'est pas précisé comment les tailles sont comparées, avec quels appareils, appareils ou sans eux. 13

Deuxième axiome de métrologie Ø Options de comparaison : 1. Laquelle des deux tailles est la plus grande ? Mesures sur une échelle d’ordre 2. Combien de plus ? Mesures à l'échelle d'intervalle 3. Combien de fois plus grand ? Mesures de l'échelle de rapport 14

Deuxième axiome de métrologie Ø Options de comparaison : 1. Laquelle des deux tailles est la plus grande ? Mesures sur une échelle d’ordre 2. Combien de plus ? Mesures à l'échelle d'intervalle 3. Combien de fois plus grand ? Mesures de l'échelle de rapport 14

Options de comparaison 1. Laquelle des deux tailles est la plus grande ? Mesures sur une échelle de commande Le résultat de la comparaison (mesures sur une échelle de commande) indique de manière convaincante que le premier produit est plus lourd que le second. Dans certains cas, cela suffit amplement 15

Options de comparaison 1. Laquelle des deux tailles est la plus grande ? Mesures sur une échelle de commande Le résultat de la comparaison (mesures sur une échelle de commande) indique de manière convaincante que le premier produit est plus lourd que le second. Dans certains cas, cela suffit amplement 15

Options de comparaison 2. Combien de plus ? Mesures sur une échelle d'intervalle Le résultat d'une mesure sur une échelle d'intervalle vous permet de déterminer de combien la masse du premier produit est supérieure à la masse du deuxième produit - par la masse de sable. 16

Options de comparaison 2. Combien de plus ? Mesures sur une échelle d'intervalle Le résultat d'une mesure sur une échelle d'intervalle vous permet de déterminer de combien la masse du premier produit est supérieure à la masse du deuxième produit - par la masse de sable. 16

Options de comparaison 3. Combien de fois plus ? Mesures sur une échelle de ratio 2 2 1 1 Le résultat des mesures sur une échelle de ratio est obtenu en comparant une taille inconnue avec une unité de mesure acceptée afin de déterminer la valeur numérique de la valeur mesurée, indiquant combien de fois la taille inconnue est plus grand que la taille de l'unité de valeur 17

Options de comparaison 3. Combien de fois plus ? Mesures sur une échelle de ratio 2 2 1 1 Le résultat des mesures sur une échelle de ratio est obtenu en comparant une taille inconnue avec une unité de mesure acceptée afin de déterminer la valeur numérique de la valeur mesurée, indiquant combien de fois la taille inconnue est plus grand que la taille de l'unité de valeur 17

Le troisième axiome de la métrologie L'influence combinée de nombreux facteurs différents, dont la comptabilité exacte est impossible et le résultat est imprévisible, conduit au fait que : Le résultat de la mesure est ALÉATOIRE Conséquence : Le résultat de la mesure n'a pas de signification spécifique 18

Le troisième axiome de la métrologie L'influence combinée de nombreux facteurs différents, dont la comptabilité exacte est impossible et le résultat est imprévisible, conduit au fait que : Le résultat de la mesure est ALÉATOIRE Conséquence : Le résultat de la mesure n'a pas de signification spécifique 18

Le troisième axiome de la métrologie Facteurs influençant le résultat de la mesure A priori Durant le processus de mesure A posteriori 19

Le troisième axiome de la métrologie Facteurs influençant le résultat de la mesure A priori Durant le processus de mesure A posteriori 19

Facteurs influençant le résultat de la mesure A priori Qualité et quantité de l'information a priori Inadéquation du modèle à l'objet Imperfection de la méthode de mesure Imperfection de l'instrument de mesure 20

Facteurs influençant le résultat de la mesure A priori Qualité et quantité de l'information a priori Inadéquation du modèle à l'objet Imperfection de la méthode de mesure Imperfection de l'instrument de mesure 20

Facteurs influençant le résultat de la mesure Pendant le processus de mesure Installation incorrecte des instruments de mesure Influence des instruments de mesure sur l'objet Impact des grandeurs d'influence Qualification et état psychophysiologique du personnel 21

Facteurs influençant le résultat de la mesure Pendant le processus de mesure Installation incorrecte des instruments de mesure Influence des instruments de mesure sur l'objet Impact des grandeurs d'influence Qualification et état psychophysiologique du personnel 21

Facteurs influençant le résultat de la mesure A posteriori Qualité de l'algorithme de traitement des données Imperfection de l'outil de traitement des données Qualification et état psychophysiologique du personnel 22

Facteurs influençant le résultat de la mesure A posteriori Qualité de l'algorithme de traitement des données Imperfection de l'outil de traitement des données Qualification et état psychophysiologique du personnel 22

Métrologie théorique ?

Grandeur physique?

Qu'est-ce qu'une unité de mesure

Unité de mesure de la grandeur physique est une grandeur physique de taille fixe, à laquelle est classiquement attribuée une valeur numérique égale à un, et qui est utilisée pour l'expression quantitative de grandeurs physiques qui lui sont similaires. Les unités de mesure d'une certaine quantité peuvent différer en taille, par exemple, le mètre, le pied et le pouce, étant des unités de longueur, ont des tailles différentes : 1 pied = 0,3048 m, 1 pouce = 0,0254 m.

Quelles sont les déclarations sous-jacentes ?

En métrologie théorique, trois postulats (axiomes) sont adoptés, qui guident les trois étapes du travail métrologique :

En préparation aux mesures (postulat 1);

Lors de la réalisation de mesures (postulat 2) ;

Lors du traitement des informations de mesure (postulat 3).

Postulat 1: Sans information a priori, la mesure est impossible.

Postulat 2 : la mesure n’est rien d’autre qu’une comparaison.

Postulat 3 : Le résultat de la mesure sans arrondi est aléatoire.

Le premier axiome de la métrologie : Sans information a priori, la mesure est impossible. Le premier axiome de la métrologie fait référence à la situation avant la mesure et dit que si nous ne savons rien de la propriété qui nous intéresse, alors nous ne saurons rien. En revanche, si tout est connu à ce sujet, alors la mesure n’est pas nécessaire. Ainsi, la mesure est causée par un manque d'informations quantitatives sur une propriété particulière d'un objet ou d'un phénomène et vise à la réduire.

La présence d'informations a priori sur n'importe quelle taille s'exprime dans le fait que sa valeur ne peut pas être également probable dans la plage de -¥ à +¥. Cela signifierait que l'entropie a priori

et pour obtenir des informations de mesure

pour toute entropie postérieure H, une quantité d’énergie infiniment grande serait nécessaire.

Deuxième axiome de métrologie : la mesure n’est rien d’autre qu’une comparaison. Le deuxième axiome de la métrologie concerne la procédure de mesure et dit qu'il n'existe pas d'autre moyen expérimental d'obtenir des informations sur des dimensions autrement qu'en les comparant les unes aux autres. La sagesse populaire, selon laquelle « tout se connaît par comparaison », fait ici écho à l'interprétation de la mesure par L. Euler, donnée il y a plus de 200 ans : « Il est impossible de déterminer ou de mesurer une grandeur sans prendre pour connue une autre grandeur de la du même genre et indiquant la relation dans laquelle il se trouve avec elle.

Le troisième axiome de la métrologie : Le résultat de la mesure sans arrondi est aléatoire. Le troisième axiome de la métrologie concerne la situation après la mesure et reflète le fait que le résultat d'une procédure de mesure réelle est toujours influencé par de nombreux facteurs différents, y compris aléatoires, dont la prise en compte exacte est en principe impossible, et le résultat final est imprévisible. En conséquence, comme le montre la pratique, avec des mesures répétées de la même taille constante, ou avec des mesures simultanées par différentes personnes, différentes méthodes et moyens, des résultats inégaux sont obtenus, à moins qu'ils ne soient arrondis (grossiés). Il s'agit de valeurs individuelles d'un résultat de mesure de nature aléatoire.

L'un des axiomes les plus importants de ce type, appelé « postulat fondamental de la métrologie », a été formulé par I.F. Shishkin est toujours dans le manuel

GÉORGIE. Kondrachkova,Docteur en Sciences Techniques,

Académicien (membre du présidium) de l'Académie métrologique de la Fédération de Russie

Université technologique d'État des polymères végétaux de Saint-Pétersbourg, Saint-Pétersbourg

Un manuel sur le cours « Théorie générale des mesures » a été publié. L'auteur du manuel est un représentant de l'école scientifique de Saint-Pétersbourg (Mendeleev), un ancien employé du VNIIM du nom. DI. Mendeleev, fondateur du département de base de métrologie de l'Université technique d'État du Nord-Ouest (le 25 janvier 2010, ce département fêtera son 30e anniversaire). Contribution d'I.F. Shishkin est largement connu dans le développement de l'enseignement métrologique : en tant que président du Conseil scientifique et méthodologique de l'Éducation nationale de l'URSS sur la métrologie, la normalisation et la qualité, il a reçu en 1989 le certificat d'honneur de la norme d'État de l'URSS. pour la création dans notre pays d'une nouvelle spécialité d'ingénierie « Métrologie, normalisation et gestion de la qualité », qui a ensuite été divisée en spécialités actuellement existantes « Métrologie et support métrologique », « Normalisation et certification » et « Gestion de la qualité ».

Dans le manuel, de nombreuses idées et développements scientifiques et méthodologiques de l'auteur, précédemment publiés dans la littérature pédagogique et testés dans le processus éducatif, ont reçu leur forme définitive. Ils reposent sur une approche axiomatique de la construction et de la présentation du matériel.

On sait que traduire toute théorie sur une base axiomatique lui confère non seulement de l'harmonie, mais aussi de l'exhaustivité. Le rejet d'un seul des cinq axiomes d'Euclide a conduit, par exemple, Lobatchevski à la création d'une géométrie non euclidienne, qui a révolutionné les idées sur la nature de l'espace. La théorie des mesures à cet égard ne fait pas exception, ce qui explique les tentatives de la transférer sur une base axiomatique (voir par exemple les travaux, etc.).

L'un des axiomes les plus importants de ce type, appelé « postulat fondamental de la métrologie », a été formulé par I.F. Shishkin est toujours dans le manuel. On pouvait y lire : « Le résultat de la mesure est une variable aléatoire. »

Ainsi, il a été souligné qu'en pratique, les mesures sont toujours effectuées sous l'influence de nombreux facteurs dont la comptabilité exacte est impossible et dont le résultat est imprévisible. Par conséquent, le résultat de la comparaison d’une taille inconnue (c’est-à-dire la dimension Q avec une dimension connue, qui est généralement la taille de l’unité de mesure [Q]), est un nombre aléatoire :

appelé un compte, plutôt qu'une valeur numérique de la quantité mesurée q dans la formule :

Q = q[Q],

qui dans la littérature métrologique est appelée pour une raison quelconque « équation de mesure de base ». Bien entendu, si vous réduisez la précision de l'appareil ou arrondissez la lecture, cela (la valeur q) restera inchangé lorsque la procédure de mesure est répétée, c'est-à-dire ne sera plus un nombre aléatoire. Ceci est pris en compte dans la version suivante du postulat principal de la métrologie, donné dans la préface du manuel : « Le résultat de la mesure sans arrondi est aléatoire ». Dans cette formulation finale, cette affirmation a été incluse dans les supports pédagogiques et les manuels scolaires comme troisième axiome de la métrologie∗.

Le troisième axiome de la métrologie clarifie beaucoup de choses. En particulier, cela explique pourquoi l’appareil mathématique adéquat pour cette science est la théorie des probabilités et les statistiques mathématiques, que les métrologues sont « condamnés » à étudier en raison de circonstances objectives indépendantes de leur volonté. Il devient clair pourquoi le résultat de la mesure ne peut pas être représenté par un nombre spécifique (il ne peut être représenté que par un ensemble de données expérimentales, la loi empirique de distribution de probabilité ou des estimations des caractéristiques numériques de cette loi), pourquoi il est impossible de déterminer la valeur non aléatoire de la grandeur mesurée Q, mais vous ne pouvez indiquer que l'intervalle dans lequel elle se situe avec une probabilité ou une autre, etc. et ainsi de suite. Ce sont toutes des conséquences qui découlent du troisième axiome de la métrologie.

Cependant, la question restait : quel bénéfice peut-on tirer, par exemple, du résultat d'une seule mesure si l'on sait à l'avance qu'elle est aléatoire ? Si a priori il n'y a pas de valeurs préférées parmi toutes ses valeurs aléatoires, alors l'intervalle de valeurs également probables du résultat de la mesure s'étend à l'infini. En termes de théorie de l'information, on peut dire que l'entropie a priori de la source du message est égale à l'infini, et pour obtenir au moins certaines informations (dans ce cas, des mesures) il faudra une quantité d'énergie infiniment grande, qui, bien sûr , est impossible. Cela conduit à la conclusion que « la mesure est impossible sans information a priori ». C'est le premier axiome de la métrologie.

Le premier axiome de la métrologie établit l’importance fondamentale de la connaissance a priori. Si nous ne savons rien à l’avance du résultat d’une mesure, nous ne saurons rien.

Les informations a priori sont contenues dans l'expérience des mesures précédentes : sous la forme de la loi de distribution de probabilité du résultat de la mesure, de ses caractéristiques numériques, des facteurs d'influence, des sources et des composantes d'erreur. Les classes de précision des instruments de mesure constituent une forme généralisée de représentation des informations a priori.

En utilisant des informations a priori, le problème inverse de la théorie de la mesure est résolu : une transition est effectuée de la valeur aléatoire du résultat de mesure à la sortie de l'appareil de mesure à la valeur non aléatoire de la grandeur mesurée à son entrée.

Le fait que la comparaison expérimentale de tailles homogènes soit le seul moyen d'obtenir des informations de mesure est connu depuis longtemps (L. Euler, M.F. Malikov, etc.). Ayant postulé cette position comme deuxième axiome de la métrologie : « La mesure est une comparaison expérimentale de tailles », I.F. Shishkin a analysé toutes les méthodes de comparaison et a constaté que dans la métrologie traditionnelle, formalisée par la loi, seules deux méthodes de comparaison sont utilisées : selon le principe « combien de plus/moins (ou égal) » et selon le principe « combien de fois plus /moins (ou égal)” . Ils conduisent respectivement à des échelles de mesure d'intervalles et de rapports. Mais il existe une autre manière de comparer utilisant le principe « supérieur à/inférieur à (ou égal) », qui conduit à une échelle de mesure de l’ordre. Cette échelle est utilisée en qualimétrie, pour mesurer des quantités non physiques (en psychologie, sociologie et autres sciences humaines), dans les mesures organoleptiques et dans de nombreux autres domaines de la connaissance scientifique. Curieusement, il est également utilisé dans les mesures instrumentales, comme le montre de manière convaincante l'exemple de la théorie des indicateurs.

Restant en dehors du champ d'application de la métrologie légale, les mesures sur une échelle de commande ne sont pas soumises à la loi de la Fédération de Russie « sur la garantie de l'uniformité des mesures ». Leur unité n’est pas assurée et les résultats sont donc illégitimes. Cela ne permet pas d’utiliser des méthodes de recherche quantitatives précises ni d’obtenir des informations de mesure fiables là où elles sont nécessaires. L'inclusion de mesures à l'échelle de l'ordre dans la métrologie est de nature systémique et peut conduire à une percée dans plusieurs domaines du développement socio-économique à la fois.

En général, la parution du manuel peut être considérée comme un événement en métrologie. Il forme une idée de la théorie générale des mesures en tant que science intégrale, qui a son propre sujet sans compilations ni emprunts, son propre système d'axiomes et de corollaires, couvrant tous les domaines d'activité pratique. De plus, il élargit considérablement le champ d'application de la théorie, couvrant des domaines non traditionnels, créant les conditions préalables au développement d'autres sciences basées sur des recherches quantitatives précises, décrivant les moyens d'améliorer le cadre juridique du soutien métrologique. C'est exactement ce que devrait être un manuel, répondant aux exigences de formation avancée des spécialistes de notre pays.

Comme toute autre science, théorie de la mesure(la métrologie) se construit sur la base d’un certain nombre de postulats fondamentaux qui décrivent ses axiomes initiaux.

Le premier postulat de la théorie de la mesure est postulat A :dans le cadre du modèle accepté de l'objet d'étude, il existe une certaine quantité physique et sa vraie valeur.

Si l’on suppose que la pièce est un cylindre (le modèle est un cylindre), alors elle a un diamètre mesurable. Si la pièce ne peut pas être considérée comme cylindrique, par exemple si sa section est une ellipse, alors mesurer son diamètre est inutile, car la valeur mesurée ne contient aucune information utile sur la pièce. Et donc, dans le cadre du nouveau modèle, le diamètre n’existe pas. La grandeur mesurée n'existe que dans le cadre du modèle accepté, c'est-à-dire qu'elle n'a de sens que tant que le modèle est reconnu comme adéquat à l'objet. Puisque, à des fins de recherche différentes, différents modèles peuvent être comparés à un objet donné, alors à partir du postulat UNécoule

conséquence UN 1 : pour une grandeur physique donnée de l'objet mesuré, il existe de nombreuses grandeurs mesurées (et, par conséquent, leurs vraies valeurs).

Du premier postulat de la théorie de la mesure, il découle que la propriété mesurée d'un objet de mesure doit correspondre à un paramètre de son modèle. Ce modèle doit permettre de considérer ce paramètre inchangé pendant le temps nécessaire à la mesure. Sinon, les mesures ne peuvent pas être prises.

Ce fait est décrit postulat B :la vraie valeur de la grandeur mesurée est constante.

Après avoir identifié un paramètre constant du modèle, vous pouvez procéder à la mesure de la valeur correspondante. Pour une grandeur physique variable, il est nécessaire d'isoler ou de sélectionner un paramètre constant et de le mesurer. Dans le cas général, un tel paramètre constant est introduit à l'aide de certaines fonctionnelles. Un exemple de tels paramètres constants de signaux variant dans le temps introduits via des fonctionnelles sont les valeurs moyennes quadratiques rectifiées. Cet aspect se reflète dans

conséquence B1 :Pour mesurer une grandeur physique variable, il est nécessaire de déterminer son paramètre constant - la grandeur mesurée.

Lors de la construction d’un modèle mathématique d’un objet de mesure, il faut inévitablement idéaliser certaines de ses propriétés.

Un modèle ne peut jamais décrire complètement toutes les propriétés d'un objet mesuré. Il reflète, avec un certain degré d'approximation, certains d'entre eux qui sont essentiels à la résolution d'une tâche de mesure donnée. Le modèle est construit avant la mesure sur la base d'informations a priori sur l'objet et en tenant compte de la finalité de la mesure.

La grandeur mesurée est définie comme un paramètre du modèle adopté, et sa valeur, qui pourrait être obtenue à la suite d'une mesure absolument précise, est acceptée comme la vraie valeur de cette grandeur mesurée. Cette idéalisation inévitable, adoptée lors de la construction d'un modèle de l'objet de mesure, détermine

l'inévitable écart entre le paramètre du modèle et la propriété réelle de l'objet, appelé seuil.

Le caractère fondamental de la notion de « écart de seuil » est établi postulat C :il existe un écart entre la quantité mesurée et la propriété de l'objet étudié (seuil d'écart entre la quantité mesurée) .

L'écart de seuil limite fondamentalement la précision de mesure réalisable avec la définition acceptée de la grandeur physique mesurée.

Les changements et les clarifications de l'objectif de la mesure, y compris ceux qui nécessitent d'augmenter la précision des mesures, conduisent à la nécessité de modifier ou de clarifier le modèle de l'objet mesuré et de redéfinir le concept de grandeur mesurée. La principale raison de la redéfinition est que l'écart de seuil avec la définition précédemment acceptée ne permet pas d'augmenter la précision des mesures jusqu'au niveau requis. Le paramètre mesuré nouvellement introduit dans le modèle peut également être mesuré uniquement avec une erreur, qui au mieux

le cas est égal à l’erreur due à l’écart de seuil. Puisqu'il est fondamentalement impossible de construire un modèle absolument adéquat de l'objet de mesure, il est impossible

éliminer l'écart de seuil entre la grandeur physique mesurée et le paramètre du modèle de l'objet mesuré qui la décrit.

Cela conduit à un point important conséquence C1 :la vraie valeur de la quantité mesurée ne peut pas être trouvée.

Un modèle ne peut être construit que s'il existe des informations a priori sur l'objet de mesure. Dans ce cas, plus il y a d'informations, plus le modèle sera adéquat et, par conséquent, son paramètre décrivant la grandeur physique mesurée sera choisi avec plus de précision et de justesse. Par conséquent, l’augmentation des informations préalables réduit l’écart de seuil.

Cette situation se reflète dans conséquenceAVEC2: la précision de mesure réalisable est déterminée par des informations a priori sur l'objet de mesure.

De ce corollaire il résulte qu’en l’absence d’information a priori, la mesure est fondamentalement impossible. Dans le même temps, le maximum d'informations a priori possible réside dans une estimation connue de la grandeur mesurée, dont la précision est égale à celle requise. Dans ce cas, aucune mesure n’est nécessaire.